주무부처 과기정통부, 전담기관 한국지능정보사회진흥원

당국이 개설한 AI 플랫폼에서 이름·주소·전화번호 등 노출

[뉴스포스트=김윤진 기자] AI 정책 당국이 개설한 AI 플랫폼에서 2019년부터 국민 개인정보가 노출돼온 것으로 확인됐다.

과학기술정보통신부와 한국지능정보사회진흥원(NIA)은 AI를 연구하는 개인·단체에 'AI 학습용 데이터'와 '고성능 컴퓨팅 자원'을 무료로 제공하는 온라인 플랫폼 'AI허브'를 운영 중이다. 이번 개인정보 노출은 AI허브를 통해 개방한 'AI 학습용 데이터'들 가운데 일부에서 비롯했다.

AI허브는 현재 AI 학습용 데이터 915종을 누구나 쉽게 열람할 수 있도록 열어뒀다. 그중 하나인 'A(가칭)' 데이터셋(DataSet)은 자연어 처리(NLP)와 거대 언어 모델(LLM) 학습에 활용 가능한 대화문인데, 이 파일 안에 국민들의 이름·주소·생년월일·휴대전화번호 등의 정보가 여과 없이 드러나 있던 것이다.

과기정통부·NIA·KISTI의 허술한 관리감독

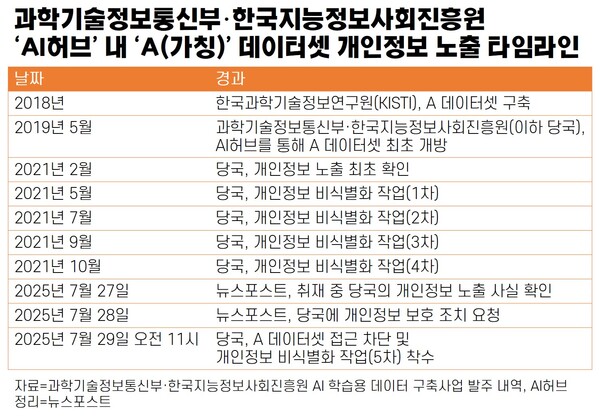

7일 뉴스포스트 취재를 종합하면 A 데이터셋은 한국과학기술정보연구원(KISTI)이 2018년 구축했다. 개방은 2019년 5월에 이뤄졌다. 개인정보를 노출당한 국민은 최소 수십 명이다. 본지가 파악 못한 정보가 존재할 가능성도 있는 데다, 개인·단체의 다운로드 수가 수천 건에 달해 파장이 예상된다.

더 큰 문제는 첫 노출이 아니라는 것이다. 본지가 입수한 A 데이터셋의 초기 버전에는 현 버전보다 개인정보 수가 많았다. 과학기술정보통신부·한국지능정보사회진흥원(이하 당국)은 2021년 2월 노출을 최초 인지한 뒤, 약 3개월에 걸쳐 개인정보 비식별화(알아볼 수 없게 수정) 작업을 1차 진행하고 데이터셋을 재개방했다.

1차 작업을 하고도 개인정보 비식별화는 완벽하지 않았다. 당국은 다시 2개월간 2차 수정했으나 역시 개인정보 보호가 미흡한 채로 재개방했다. 이후 3개월 동안 3, 4차 수정과 재개방을 반복했다. 당국과 수행기관 KISTI의 허술한 관리감독이 드러나는 대목이다.

지난달 28일 본지의 취재가 시작되자, 당국은 다음날 오전 11시부터 개인·단체의 A 데이터셋에 대한 접근을 막고 개인정보 비식별화 5차 작업에 들어갔다.

다섯 번째 작업이므로 이번에도 비식별화가 철저할지는 미지수다. 나아가 당국이 개방한 AI 학습용 데이터는 A 데이터셋을 포함해 915종에 달하는 만큼, 빙산의 일각일 가능성도 배제할 수도 없다.

실제로 본지가 입수한 'B(가칭)' 데이터셋의 2021년 6월 버전에도 국민들의 이름·전화번호 등 개인정보가 식별 가능한 상태로 있었다. 당국은 B 데이터셋도 같은 해에 비식별화를 네 차례나 작업했다. 현재는 개인정보 노출 문제를 개선한 것으로 보인다.

대기업·대학교, 자체 AI 모델에 학습시켰다

A 데이터셋에 속한 개인정보는 당국이 AI허브에 노출한 선에서 끝나지 않았다. 거대 언어 모델을 개발하는 대기업 ㄱ사, 일선 금융사에 AI 챗봇을 공급하는 ㄴ사, 자연어 처리를 연구하는 사립 대학교 연구소 등이 AI 학습 용도로 썼다.

대기업 IT서비스 계열사 ㄷ사는 그룹사에 제공하는 IT서비스 고도화에 B 데이터셋을 활용했다. ㄷ사는 B 데이터셋을 구축한 수행기관이기도 했다.

당국은 개인·단체들이 A와 B 데이터셋에 든 개인정보를 비식별화해 활용했는지 점검에 나설 필요가 있다. 본래 비식별화는 발주처인 당국과 구축 수행기관의 역할이다. 다만 개인·단체가 전처리 과정에서 개인정보를 제거했다면, AI 모델이 답변을 통해 개인정보를 유출하는 사태는 피할 수 있다.

해당 AI 학습용 데이터를 그대로 활용한 기업들은 주의해야 한다. 당사자 동의 없이 개인정보를 AI 학습 용도로 써서 손해를 입히면 민사상 배상을 해야할 수 있다. 당국은 AI허브를 통해 개방한 데이터셋 활용에 따르는 법적 책임을 개인·단체에 돌리고 있으며, 구제해주지 않는다.

개인정보 노출이나 유출 피해자로서 손해를 입었다면 개인정보 분쟁조정위원회에 분쟁조정을 신청할 수 있다. 분쟁조정은 소송의 대안으로, 비용 없이 분쟁을 해결 가능한 제도다.

당국 "해당 개인정보는 관련 법상 보호 대상 아니다"

이번 사건의 핵심은 크게 4가지다. 첫째는 당사자로부터 개인정보를 AI 학습 용도로 활용하겠다는 동의를 받지 않은 것. 둘째는 동의를 받지 않았으면 개인정보를 비식별화해야 하지만 그러지 않은 것. 셋째는 6년간 이 같은 사실을 아무도 몰랐다는 것. 넷째는 당국이 아직도 A 데이터셋을 보유한 개인·단체들에게 활용 중지 및 자료 파기를 권하지 않고 있는 것이다.

당국에 따르면 해당 개인정보들은 A 데이터셋 구축 참여자 본인 또는 국민 누군가의 것이다. 참여자들은 작가가 집필한 시나리오를 보며 대화 상황을 연기했다. 이 과정에서 본인이나 무작위 개인정보를 언급했는데, 당국과 구축 수행기관이 보호 조치를 취하지 않은 것이다.

뉴스포스트 취재 결과 대부분의 주소·전화번호 등은 실존 인물의 정보인 것으로 확인됐다. 그럼에도 이들은 개인정보보호법상 보호 대상은 아니라고 한다. 이 같은 사례가 처음 있는 일이 아닌 만큼, 사각지대를 해소할 국회·당국 차원의 입법 활동이 시급해 보인다.

과학기술정보통신부 관계자는 "해당 데이터는 창작된 재현 데이터 및 일부 작업 참여자 본인의 정보로, 2021년부터 2022년까지 경찰 조사 등을 통해 개인정보보호법상 개인정보 유출로 보기 어려운 점을 확인했다"고 밝혔다.

그러면서 "향후에도 유사 사례가 재발하지 않도록 지속적인 점검과 필요한 경우 적절한 조치를 취해나갈 예정"이라고 덧붙였다. 당국은 우선 A 데이터셋 개인정보 비식별화 작업을 시작했고, 이후 AI허브 내 데이터셋 915종 전수조사와 더불어 재발 방지를 위한 대책을 마련할 계획이다.

그간 당국은 대규모 AI 사업을 관리감독할 역량이 없는 것으로 평가받아 왔다. 이런 상황에서 이재명 대통령은 과학기술정보통신부에 사기업 출신 배경훈 장관을 임명했다. 최근 독자 AI 파운데이션 모델 프로젝트 정예팀에 오른 LG연구원 초대 원장을 지낸 인사다. 배 장관 체제 하에서는 국민들의 개인정보를 안전하게 다루며 AI 학습용 데이터를 구축하길 기대한다.